डीप-फेक आणि समाजभान

Total Views |

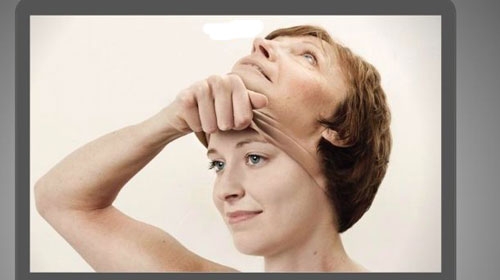

डीप-फेक वापरून खर्या व्हिडिओतला एखादा शब्द, वाक्य, आकडा, स्क्रीनशॉट किंवा संपूर्ण भाषाही परवानगी न घेता बदलता येते. एआयच्या मदतीने त्या व्यक्तीचे अस्सल वाटणारे रूप, आवाज किंवा दस्तऐवज तयार केले जातात. समाजमाध्यमांवर शहानिशा न करता वायुवेगाने असे ’डीप-फेक’ फोटो, रील्स व्हायरल होतात. यापुढे सत्य-असत्यामधली सीमारेषा अशीच पुसट होत जाणार असेल, तर समाज एका अनागोंदीच्या उंबरठ्यावर उभा आहे. त्यामुळे समाजमाध्यमांतून असे फोटो, व्हिडिओ दिसताच आपण किती जागरूक राहिले पाहिजे, याबद्दल डोळ्यात अंजन घालणारा लेख....

समाजमाध्यमांवर स्क्रोल करत बसण्याचा नाद आता अवघ्या जगाला लागला आहे. एखाद्या प्रतीक्षालयापासून चालत्या वाहनापर्यंत, कुठेही जरा संधी मिळाली की आपण सगळे आपापल्या मोबाइलमध्ये डोकी खुपसून बसलेले असतो. अचानक एखाद्या रीलमध्ये एखादी प्रसिद्ध व्यक्ती अनपेक्षित काहीतरी करताना दिसते - उदा., पंतप्रधान मोदी काही महिलांसह गरबा खेळताना दिसतात. पुष्पा फेम रश्मिका मंदाना ही अभिनेत्री नेहमीपेक्षा बोल्ड कपड्यांमध्ये लिफ्टमध्ये शिरताना दिसते.

शहानिशा न करता वायुवेगाने असे ’डीप-फेक’ फोटो, रील्स व्हायरल केले जातात. यामागे आश्चर्य, कुत्सित वृत्ती, रिकामटेकडेपणा किंवा त्यातले बातमीमूल्य.. कारण कोणतेही असू शकते. कुणी ’हे बघा बघा, काहीही दाखवतात, सावध व्हा’ असे लिहून जरी शेअर केले, तरी ते एक प्रकारे त्याचा प्रसार करण्यास हातभारच लावत असतात. आपल्याजवळ इतरांपेक्षा काहीतरी अद्भुत, हटके माहिती आहे हे सिद्ध करण्याची तर समाजमाध्यमांवर स्पर्धा लागलेली असते. एकंदरीत ’हे तुफान व्हायरल व्हावे’ हा निर्मात्याचा हेतू सफल होतो. निर्माता म्हणजे हे तयार करणाराच नव्हे, तर ’सुपारी’ देऊन करवून घेणाराही. थ्रिल, पैसा, सत्ता, राजकीय कुरघोड्या, प्रसिद्धीचा हव्यास, कुतूहल, सूडभावना अशी कोणतीही कारणे यामागे असू शकतात.

कृत्रिम बुद्धिमत्ता (ए आय) तंत्रज्ञानाचा वापर

असे मॉर्फ केलेले (बदललेले) फोटो, व्हिडिओ आधी शेअर होत नव्हते का? होते, पण ‘गूगल रिव्हर्स सर्च’सारख्या अन्य सोप्या सुविधांच्या मदतीने किंवा नीट निरीक्षण करताच त्यातला फोलपणा लक्षात येण्याची शक्यता खूप जास्त होती. आता शेअर होणारे खोटे फोटो, रील्स ही फक्त फसवेगिरी नाही, तर महाठकबाजी - ‘डीप- फेक’ आहे. डोळे फाडून बघितले, तरी ते बनावट असल्याचे सहजी ओळखू येत नाही, कारण यात अद्ययावत कृत्रिम बुद्धिमत्ता (ए आय) तंत्रज्ञानाचा वापर केला जातो. डीप-फेक फोटो, रील्स तयार करण्यासाठी लागणारा कच्चा माल म्हणजे एखाद्या व्यक्तीचा आवाज, फोटो, व्हिडिओ इ.चे अनेक नमुने. मनोरंजन, खेळ, राजकारण, समाजकारण इ. क्षेत्रांतल्या प्रसिद्ध व्यक्तींचे हजारो फोटो, व्हिडिओ इंटरनेटवर सहज कुणालाही सापडतात.

या उपलब्ध माहितीचे सखोल विश्लेषण करून बारकावे समजून घेत (डीप लर्निंग) एआयच्या मदतीने त्या व्यक्तीचे अस्सल वाटणारे रूप, आवाज किंवा दस्तऐवज तयार केले जातात. जनरेटिव्ह अॅडव्हर्सरियल नेटवर्क्सचा (GANsचा) वापर करून तयार केलेले एखाद्या व्यक्तीचे असे ‘कृत्रिम’ (सिंथेटिक) रूप म्हणजे त्याची नाकीडोळी, हावभाव, आवाज, उच्चार, शारीरिक लकबी, फोटोकॉपी/प्रत काढावी इतके सारखे असते.

काही वर्षांपूर्वी वॉशिंग्टन विद्यापीठातील संशोधकांनी ए-आयच्या भविष्याचा वेध घेताना मिशेल ओबामांनासुद्धा खरे वाटतील असे सिंथेटिक ओबामा तयार करून पाहिले होते. तो प्रयोग होता. आज बर्यापैकी तांत्रिक कौशल्य असलेल्या कुणालाही आपल्या गल्लीबोळात बसून इंटरनेटवर खुले करण्यात आलेल्या फुकट सोर्सच्या व थोड्या प्रशिक्षणाच्या मदतीने डीप-फेकचा वापर करून असे फोटो, रील्स तयार करणे शक्य आहे.

हवाई वाहतूक, लष्कर आणि आरोग्यसेवा यासारख्या विविध उद्योगांमध्ये प्रशिक्षणासाठी वास्तवदर्शी सिम्युलेशनची आवश्यकता असते. जसे विमानचालकाला सुरुवातीचे प्रशिक्षण आभासी आकाशात दिले जाते. डीप-फेक अशा क्षेत्रांसाठी अगदी खरेखुरे वाटणारे अपेक्षित विश्व उभे करू शकते. उत्तम शैक्षणिक व्हिडिओ तयार करण्यासाठी, चित्रपट, टेलिव्हिजन शोसाठी तयार केलेल्या कार्यक्रमाला अधिक वास्तववादी व प्रभावी व्हिज्युअल इफेक्ट देण्यासाठी डीप-फेक अतिशय उपयोगी आहे.

ग्राहकाला मॉडेलवर स्वत:ला डीप-फेक करून पाहता येऊ शकते.

जाहिरात विश्वात डीप-फेक अनेक करामती करू शकते. एका बिस्किट कंपनीने त्यांच्या जाहिरातीत शाहरूख खानसह आपल्या स्वत:ला पडद्यावर पाहण्याची शक्कल डीप-फेकच्या माध्यमातून लढवून ग्राहकांना अचंबित केले आहे. एखादा पोशाख, दागिना ऑनलाइन खरेदी करताना तो आपल्याला कसा दिसेल हे ग्राहकाला मॉडेलवर स्वत:ला डीप-फेक करून पाहता येऊ शकते. यामुळे ऑनलाइन खरेदीची व्यापकता वाढून ही उलाढाल कुठल्या कुठे पोहोचणार आहे.

विशिष्ट कलाकाराच्या आवाजात त्याचे मनोगत, लेखन, गीत, रचना ऐकण्याची सोय डीप-फेकमुळे होऊ शकते. इतिहासातील व्यक्तींना डीप-फेकच्या मदतीने बोलते करता येऊ शकते. उदा., अरिजीत सिंगने गायलेले गाणे आता किशोरकुमारच्या आवाजात ऐकता येते. उद्या एखाद्या राजकीय चरित्रपटात अन्य अभिनेत्यांवर वीर सावरकर, सरदार पटेल, म. गांधी किंवा पं. नेहरू यांच्या भूमिकेत त्यांचे चेहरे एम्बेड करून खुद्द तेच आपापली भूमिका करताना दिसू शकतात.

हे सगळे भयचकित करणारे आहे. या राजकीय व्यक्तिमत्त्वांच्या तोंडी त्यांनी कधीही न बोललेली पण निर्मात्याला हवी ती वाक्ये ’सिनेमॅटिक लिबर्टी’च्या नावाखाली घालण्यात आली, तर! इतिहासाशी छेडछाड करायला काही मर्यादा आहेत, कारण तत्कालीन डेटाची तांत्रिक गुणवत्ता व क्षमता डीप-फेकच्या अटीत बसणारी नाही. अर्थात ते कठीण असले, तरी अशक्य नाही. तुलनेने आजच्या राजकीय नेत्यांच्या बाबतीत आपली राजकीय स्वार्थाची पोळी शेकून घेण्यासाठी विरोधक वा प्रतिस्पर्धी कोणत्याही थराला जात असताना डीप-फेकचे नवे हत्यार उपलब्ध झाले आहे.

खुद्द पंतप्रधानांचा गरबा खेळण्याचा डीप-फेक व्हिडिओ व्हायरल होणे

खुद्द पंतप्रधानांचा गरबा खेळण्याचा डीप-फेक व्हिडिओ व्हायरल होणे ही बाब म्हणूनच अतिशय गंभीर आहे. आपण शाळकरी वयानंतर कधीही गरबा खेळलो नसल्याचे मोदींनी स्पष्ट केले आहे. गरबा खेळणे ही निरुपद्रवी घटना मानू या; पण पंतप्रधानच कशाला, एखाद्या सामान्य राजकीय किंवा सामाजिक कार्यकर्त्याचा काही आक्षेपार्ह कृत्य करतानाचा व्हिडिओ डीप-फेकच्या मदतीने समजा तयार करण्यात आला, तो व्हायरल झाला, तर! त्याने आपले निरपराधित्व यथावकाश सिद्ध केले, तरी नुकसान टाळण्याची वेळ हातून निघून गेलेली असू शकते. यामुळे एखादी व्यक्ती आयुष्यातून उठू शकते. त्याची राजकीय कारकिर्द संपुष्टात येऊ शकते. त्याच्या पक्षाचे मोठे राजकीय, सामाजिक नुकसान होऊ शकते.

एखाद्या विशिष्ट विचारसरणीच्या कार्यकर्त्याच्या विरोधात भाषणे देऊन, लेख लिहून जनमानस बदलेल न बदलेल. लोक अजूनही स्वत: बघितलेल्या गोष्टीला सत्यच मानतात. त्यामुळे एखाद्या व्हिडिओतून त्या कार्यकर्त्याच्या चारित्र्यावर शिंतोडे उडवणे व त्याचे खच्चीकरण करणे तुलनेने सोपे आहे, हे विघातक विचारांच्या विरोधकांच्या लक्षात आले आहे. डीप-फेक या दुष्कृत्यांना तांत्रिक सफाईची जोड द्यायला कारणीभूत ठरू शकते.

एखाद्या राजकीय नेत्याच्या खर्या व्हिडिओतली वाक्ये बदलून त्याच्या तोंडी वाटेल ती वाक्य किंवा अख्खे खोटे भाषण डीप-फेकच्या साहाय्याने घालता येऊ शकते. याचे किती गंभीर आर्थिक, सामाजिक परिणाम होऊ शकतात! ते वक्तव्य किंवा दृश्य खरेच मानून लोक गोंधळून जातील, संतापतील, मतपेट्यांची गणिते बदलवतील. यातून राजकीय बंड घडू शकते. हिंसाचार भडकू शकतो.

’चक्षुर्वै सत्यं’ म्हणजेच ’मी माझ्या डोळ्यांनी पाहिले’ म्हणत विश्वास ठेवायचे दिवस संपत चालले आहेत हे आपण लक्षात घेतले नाही, तर लोकशाहीसाठी ही धोक्याची घंटा आहे.

दुसर्या बाजूला एखाद्या राजकीय व्यक्तीने खरेच एखादे चुकीचे, भडक किंवा निषेधार्ह वक्तव्य अथवा कृत्य केले असले, तरी त्याचा पुरावा हा डीप-फेक असल्याचा कांगावा करून ती व्यक्ती हात झटकू शकते. डीप-फेक असल्याचे सिद्ध करायला जितका वेळ, ऊर्जा खर्ची घालावी लागेल, तेवढीच ते डीप-फेक नसल्याचे सिद्ध करायलाही.

सत्य-असत्यामधली सीमारेषा अशीच पुसट होत जाणार असेल, तर समाज एका अनागोंदीच्या उंबरठ्यावर उभा आहे.

बदनामीच्या भीतीने त्यातील काही जणी तर आयुष्य संपवतात. हे आधीही घडत होते, पण डीप-फेकमुळे त्याची तीव्रता वाढणार आहे.

डीप-फेक तंत्रज्ञानाचा तितकाच मोठा धोका महिलांना आहे. विनयभंगाच्या किंवा बलात्कारासारख्या घटना उघड करायचे त्यात बळी ठरलेल्या मुली/स्त्रिया शक्यतो टाळतात. समाजावर योनिशुचितेचा इतका प्रचंड पगडा आहे की त्याचे दडपण येऊन त्या अपराध्याला शासन करण्याचे राहोच, त्यांनाच अपराधी वाटू लागते. बदनामीच्या भीतीने त्यातील काही जणी तर आयुष्य संपवतात. हे आधीही घडत होते, पण डीप-फेकमुळे त्याची तीव्रता वाढणार आहे.

डीप-फेक वापरून एखाद्या न्यूड किंवा अश्लील फोटो/व्हिडिओमध्ये ठरवून एखाद्या स्त्रीचा चेहरा, आवाज वापरला जातो. एकदा का तो व्हायरल झाला की ती मानसिकदृष्ट्या उद्ध्वस्त होते.

आज इंटरनेटवर पॉर्न बघणार्या देशांच्या यादीत भारत तिसर्या क्रमांकावर आहे, ही वस्तुस्थिती आहे. हजारो अश्लील क्लिप्स दररोज शेअर होत असतात.

डीप-फेकमुळे एखाद्या स्त्रीचा सूड घेण्यासाठी किंवा लैंगिक विकृतीतून तिचा डीप-फेक पॉर्न व्हिडिओ तयार केला जाऊ शकतो. अधिक व्ह्यूज मिळावे, म्हणून सिनेतारकांचे डीप-फेक वापरून अश्लील व्हिडिओ व्हायरल केल्याच्या घटना अगोदरच घडल्या आहेत. काजोल, रश्मिका, कॅटरिना अशा नामांकित अभिनेत्रींबाबत हे घडले आहे.

या संदर्भात रश्मिकाने उपस्थित केलेला मुद्दा फार महत्त्वाचा आहे. ती म्हणते, “माझ्या पाठीशी आज माझे अनेक चाहते, कुटुंब आणि हितचिंतक उभे आहेत. मी सर्वसामान्य स्त्री असते, तर मी काय केले असते? यातून बोध घेऊन सर्वांनी कायम सावध राहावे, एवढेच मी सांगू शकते. दुर्दैवाने एखाद्या स्त्रीबाबत असे घडलेच, तर तिच्या कुटुंबीयांनी, सहकार्यांनी, मित्र-मैत्रिणींनी, सामाजिक संस्थांनी व पोलिसांनीही तिचे मनोधैर्य राखायला तिच्या पाठीशी ठाम उभे राहायला हवे. तसे झाले, तर याविरोधात ती सर्वांच्या सहकार्याने ताकदीने लढा देऊ शकेल. तिच्या वर्मावर घाला घालता येत नाही, हे लक्षात आले की डीप-फेकचा तिच्या विरोधात वापर करणार्याच्या हेतूलाच सुरुंग लागेल आणि या विकृतीला काही अंशी आळा घालणे शक्य होईल.”

याशिवाय समाजमाध्यमांवर वावरताना सजग राहणे, भावनेच्या आहारी न जाणे, अनोळखी मित्रविनंत्या नाकारणे इ. काळजी महिलांनी घ्यायला हवी.

डीप-फेकचे रूप घेऊन त्यांना व आपल्याला गोत्यात आणू शकतात, हे आता सर्वांनी - विशेषत: महिलांनी लक्षात ठेवायला हवे.

आपले फोटो, व्हिडिओ सतत पोस्ट करत राहणे ही वलयांकित लोकांची व्यावसायिक गरज आहे, पण आपले काय! डीप-फेकसाठी जो कच्चा माल लागतो, तो आपणच उत्साहाच्या भरात सुरक्षा सेटिंग न वापरता बिनधास्त पुरवत असतो. आपल्या जिवलगांचे आपण कौतुकाच्या भरात पोस्ट केलेले फोटो, व्हिडिओ उद्या डीप-फेकचे रूप घेऊन त्यांना व आपल्याला गोत्यात आणू शकतात, हे आता सर्वांनी - विशेषत: महिलांनी लक्षात ठेवायला हवे.

डीप-फेक तंत्रज्ञान बौद्धिक संपदा, स्वामित्व कायद्याशी संबंधित अनेक कायदेशीर व नैतिक प्रश्न निर्माण करते आहे.

डीप-फेक वापरून खर्या व्हिडिओतला एखादा शब्द, वाक्य, आकडा, स्क्रीनशॉट किंवा संपूर्ण भाषाही परवानगी न घेता बदलता येते. उदा., एखाद्याने बाजार बंद होतानाचा एखाद्या शेअरचा भाव सांगितला, तर डीप-फेक वापरून तो बदलता येऊ शकतो. एखाद्या कंपनीच्या उलाढालीचा आकडा बदलता येऊ शकतो. याचा काहींना प्रचंड अर्थिक फटका बसू शकतो, तर काहींना लाभ. यामुळे आजवर होत आलेले आर्थिक घोटाळे अधिक आधुनिक रूप घेऊन अकल्पित गंभीर परिणाम घडवतील.

सुदेश भोसले अमिताभ’सारख्या’ आवाजात गायले, तरी वेगळेपण लक्षात येते; पण डीप-फेकमुळे एखाद्याच्या आवाजाची इतकी हुबेहून नक्कल करता येते की अस्सल आणि नक्कल यातला फरक सहजी कळत नाही. या मार्च महिन्यात एका जर्मन कंपनीच्या अधिकार्याला अधिकृत फोन नंबरवरून कंपनीच्या प्रमुखाचा कॉल आला व एक मोठी रक्कम विशिष्ट खात्यात जमा करण्यास सांगितले गेले. प्रमुखाचा आवाज डीप-फेक तंत्र वापरून हुबेहूब काढण्यात आल्याचे व फसवणूक झाल्याचे रक्कम भरल्यावर उघडकीस आले. 18 जुलैला केरळमध्ये एका वयस्कर व्यक्तीला जवळच्या माजी सहकार्याचा पैसे मागणारा कॉल आला. शस्त्रक्रियेचे कारण सांगून त्यांना तोतयाने 40,000 रुपयांचा गंडा घातला. त्याने डीप-फेकच्या मदतीने माजी सहकार्याचा आवाज अगदी बेमालूमरित्या ’तयार’ केला होता. एकूण आता स्वत:च्या कानांवरही विश्वास ठेवणे कठीण होणार आहे.

हव्या त्या बातम्या पेरून राजकीय उलथापालथी घडवण्यासाठी जगातल्या महासत्तांद्वारे समाजमाध्यमांचा वापर मोठ्या प्रमाणावर होत होताच. आता तर ऑक्स्फर्ड रिसर्च ग्रूपच्या माहितीनुसार इस्रायल-हमास युद्धाबाबत दोन्ही बाजूंचे समर्थक व विरोधक मिळून तब्बल 81 देश खोट्या प्रचारमोहिमा राबवत आहेत. या युद्धाच्या परिणामांच्या नावाखाली भूतकाळातील अन्य युद्धांचे फोटो बिनदिक्कत शेअर करण्यात येत आहेत. बॉट्सचा वापर, बनावट खाती व हॅकिंगची मदत घेऊन जनमत बदलण्यासाठी, तर कुठे दिशाभूल करण्यासाठी, तर कुठे सत्य दडपण्यासाठी हे सारे सुरू आहे. डीप-फेकमुळे हे आणखी किती खालच्या पातळीवर जाईल, याची आपण कल्पनाही करू शकत नाही.

डीप-फेकच्या माध्यमातून एकूण आपली आर्थिकच नव्हे, तर वैचारिकही फसवणूक केली जाऊ शकते. या तंत्रज्ञानाने भविष्यात उभ्या केलेल्या आव्हानांच्या पार्श्वभूमीवर जी 20-ऑनलाइन शिखर परिषदेत पंतप्रधान मोदींनी सर्व नेत्यांना डीप-फेकच्या वाढत्या ’प्रादुर्भावा’बद्दल सावध करून वेळीच प्रतिबंध करण्याचे आवाहन केले आहे.

ऑनलाइन तोतयेगिरी हा 2000च्या माहिती तंत्रज्ञान कायद्याच्या कलम 66D अंतर्गत गुन्हा आहे. फसवणूक झालेल्या व्यक्तीने आपले हसे होईल अशी भीती व भीड न बाळगता पोलिसांकडे ताबडतोब तक्रार करायला हवी. समाजमाध्यमवर एखादी व्यक्ती संशयास्पद वागत असेल, तर तिचे खाते त्या प्लॅटफॉर्मला रिपोर्ट करता येते, त्या व्यक्तीला ब्लॉक करता येते. आपले मॉर्फ व डीप-फेक केलेले फोटो व्हिडिओ समाजमाध्यमांवरून काढून टाकण्यासाठी stopncii.org सारख्या वेबसाइटचाही एका मर्यादेपर्यंत उपयोग होऊ शकतो.

चुकीच्या माहितीचा प्रसार रोखणे ही मुळात समाजमाध्यम प्लॅटफॉर्मची जबाबदारी असल्याची केंद्रीय मंत्री राजीव चंद्रशेखर यांनी परखड शब्दात आठवण करून दिली आहे. येत्या महिन्यात याविषयी अधिक कडक कायदे केले जाणार आहेत. पडताळणीचे टूल्स वापरणे या माध्यमांसाठी बंधनकारक असेल, त्यामुळे व्हिडिओ बनावट आहे की नाही हे तपासता येईल. व्हिडिओ डीप-फेक असल्याचे आढळल्यास व 36 तासांत तो न हटवल्यास इंटरमिडिएटची सुविधा संपुष्टात आणली जाऊ शकते. फेक व डीप-फेक फोटो/व्हिडिओ तयार करणारी अॅप्स प्ले स्टोअरवर उपलब्ध असू नयेत, याकडे लक्ष दिले जाईल.

डीप-फेक शोधणे कमालीचे अवघड असले, तरी अत्यंत बारकाईने पाहिल्यास डीप-फेक ओळखू येण्याची शक्यता असते. आलिया भटने राष्ट्रीय पुरस्कार स्वीकारताना तिच्या लग्नातली साडी पुन्हा नेसली होती, इतके निरर्थक तपशील माहीत असलेल्या समाजमाध्यमग्रस्त लोकांना तर ते नक्की ओळखू येईल. उदा., खरी रश्मिका डीप-फेक व्हिडिओतल्या रश्मिकापेक्षा चणीने बारीक आहे.

युक्रेनचे अध्यक्ष झेलेन्स्की यांच्या एका डीप-फेक व्हिडिओमध्ये ते रशियाला शरण जाताना दिसत होते. तथापि, व्हिडिओतील व्यक्तीचे मोठे डोके आणि जरासे वेगळे उच्चार, यामुळे तो डीप-फेक असल्याचे लक्षात आले आणि अखेरीस तो व्हिडिओ समाजमाध्यमांवरून काढून टाकण्यात आला. काही प्लॅटफॉर्म वॉटरमार्कच्या किंवा खुणेच्या साहाय्याने तो फोटो किंवा व्हिडिओ ए-आय वापरून तयार केल्याचे स्वत:होऊन सूचित करत असतात. तिकडे लक्ष द्यायला हवे.

सॉफ्टवेअर अभियंते, सरकार आणि तज्ज्ञ पत्रकार फोटोंच्या, कागदपत्रांच्या, व्हिडिओच्या सत्यतेची ग्वाही देऊ शकतात, तसेच खोटेपणा उघड करू शकतात. म्हणूनच गरबा व्हिडिओचा संदर्भ देत पंतप्रधानांनी नुकत्याच झालेल्या दिवाळी मेळाव्यात देशातील पत्रकारांना याविषयी जनजागृती करण्याचे आवाहन केले आहे.

जनजागृती होण्यासाठी माध्यम हाताळण्याची समज विकसित करणे गरजेचे आहे. परंतु अपवाद वगळता भारतीय समाज अद्याप पुरेसा माध्यमशिक्षित नाही. आपण याकडे तीन स्तरांतून पाहू या. एक गट ज्येष्ठ नागरिकांचा आहे. ’फॉर्वर्डेड अॅज रिसीव्ह्ड’ म्हणत जे दिसेल ते पुढे पाठवणारा आणि समाजमाध्यमांवर आले म्हणजे खरेच असेल असे मानणारा हा भाबडा गट आहे. मध्यमवयीन गट जगभरातून येणार्या माहितीच्या लोंढ्यालाच ज्ञान मानू लागला आहे. आलेली माहिती केवळ आपल्या राजकीय, वैचारिक विचारांशी जुळणारी असली म्हणजे झाले, एवढाच फॉरवर्ड करण्यामागे त्यांचा हेतू असतो. तर्क, शहानिशा या गोष्टी त्यांच्या फॉरवर्ड करण्याच्या उत्साहाच्या आड येत नाही. तिसरा युवा गट आहे. यातला उच्चशिक्षित व सुखवस्तू युवकवर्ग ग्लोबल जीवनपद्धतीशी जुळवून घेण्याच्या घाईत आहे, तर अल्पशिक्षित व गांजलेला युवकवर्ग आपले नैराश्य काढण्यासाठी समाजमाध्यमांचा वापर करतो आहे. मन रमवण्यासाठी यांना ’वैचित्र्य’ हवे आहे. ते वैचित्र्य डीप-फेकच्या माध्यमातून कमालीच्या आकर्षक आणि रंजक पद्धतीने अनुभवता येते आहे. त्यात तथ्य आहे की नाही यापेक्षा मजा येणे त्यांच्यासाठी महत्वाचे आहे. तिन्ही स्तरांचा विचार करता फेक अथवा डीप-फेक व्हायरल होण्यासाठी अत्यंत पूरक अशी परिस्थिती असल्याचे दुर्दैवाने दिसून येते. पंतप्रधान जेव्हा आपल्याला ’जागरूक’ व्हा म्हणत आहेत, त्यासाठी मुळात सत्यशोधन करायला आपला विवेक जागृत असायला हवा. झापडबंद पद्धतीने समाजमाध्यम वापरता कामा नये. संदर्भ द्यायला/विचारायला हवेत. तर्कशुद्ध विचार करून माहिती सुसंगत वाटते आहे ना, हे पाहायला हवे.

विश्वासार्ह स्रोतांनी दुजोरा दिल्याशिवाय किंवा अधिकृत चॅनलवर उल्लेख असल्याशिवाय आणि असला तरी आवश्यकता असल्याशिवाय कोणतीही माहिती पुढे पाठवण्याचा मोह टाळायला हवा.

वस्तुस्थितीची खातरजमा करण्यासाठी अनेक वेबसाइट्स आहेत. इंटरनेटवरील माहितीच्या महापुरात सूर मारून आपल्या हाती असलेली माहिती कितपत विश्वसनीय आहे, हे विविध स्रोत संदर्भ देऊन त्या सांगू शकतात. खुंटा अधिक बळकट करायला एकाहून जास्त साइट्स वापरायला हरकत नाही.

factcheck.org, washingtonpost.com/news/fact-checker, bbc.com/news/realityšcheck या साइट्स व्यतिरिक्त भारतातील altnews.in, boomlive.in, thequint.com किंवा विविध राष्ट्रीय वर्तमानपत्रांच्या वेबसाइटवरचे फॅक्टचेक विभाग यासाठी उपलब्ध आहेत.

हे सारे वेळखाऊ आहे, पण आपला एक चुकीचा फॉरवर्ड कुणाच्या जिवावर, अस्तित्वावर, चारित्र्यावर बेतणार असेल, कुणाचे थोडेसेही नुकसान करणार असेल तर एक जबाबदार नागरिक म्हणून सेंड बटण दाबण्याआधी आपण एवढे कष्ट घ्यायलाच हवेत.